Qiu L, Sha F, Allen K et al. (2026) Bayesian teaching enables probabilistic reasoning in large language models. Nature Communication 17, 1238 – https://doi.org/10.1038/s41467-025-67998-6 – open access article pdf – CC BY-NC-ND 4.0

Abstract (povzetek):

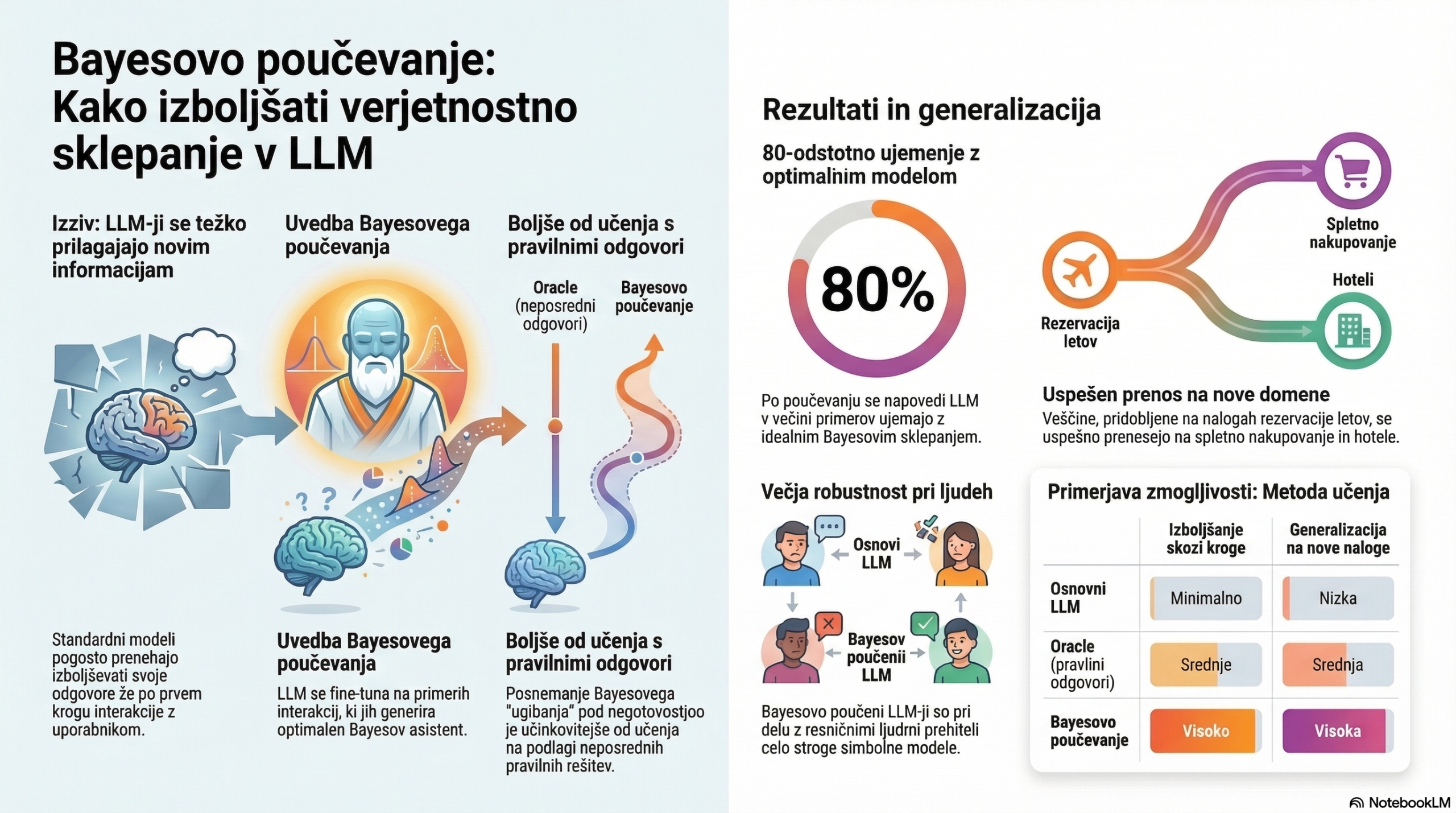

Veliki jezikovni modeli (angl. Large language model – LLM) se vse pogosteje uporabljajo kot agenti, ki komunicirajo z uporabniki in svetom. Da bi to uspešno počeli, morajo veliki jezikovni modeli ustvariti predstavitve sveta in oblikovati verjetnostna prepričanja o njih. Da bi na primer zagotovili osebna priporočila, mora veliki jezikovni model izvedeti uporabnikove preference iz njegovega vedenja v več interakcijah. Bayesov okvir sklepanja določa optimalen način, kako agent posodobi svoja prepričanja, ko prejme nove informacije. Najprej pokažemo, da veliki jezikovni modeli daleč zaostajajo za standardom, ki ga določa bayesov okvir. Nato pokažemo, da lahko z učenjem velikih jezikovnih modelov, da posnemajo napovedi normativnega bayesovega modela, dramatično izboljšamo njihovo sposobnost posodabljanja prepričanj; ta sposobnost se generalizira na nove naloge. Sklepamo, da se veliki jezikovni modeli lahko učijo sposobnosti razmišljanja iz primerov in te sposobnosti generalizirajo na nova področja.

Povzetek prispevka kot predstavitev z zdrski.